Fri Jul 01 15:28:35 CST 2022

AZFT智能、设计、体验与审美实验室(IDEA Lab)团队两篇论文 "RelyMe:Improving Lyric-to-Melody Generation by Incorporating Lyric-Melody Relationships" 和 "SongDriver: Real-time Music Accompaniment Generation without Logical Latency nor Exposure Bias" 被国际顶会ACM-MM录用。ACM MM(ACM International Conference on Multimedia),是计算机科学领域中多媒体领域的首要国际会议。多媒体研究的重点是整合不同数字形式(包括图像,文本,视频,音乐,传感器数据,口头音频)提供的多种视角。自1993年以来,ACM MM一直将学术界和工业界的研究人员和从业人员汇聚在一起,提出创新的研究成果并讨论最新进展。会议的一个特别部分是艺术计划,该计划探索计算机科学与艺术的界限。

本届ACM MM共有有效投稿2473篇,其中录取690篇论文,录取率约为27.9%。会议将于10月10日在里斯本举行。

01 RelyMe:Improving Lyric-to-Melody Generation by Incorporating Lyric-Melody Relationships作者列表:

章晨,张律勤,吴宋若瑶,谭旭,秦涛,刘铁岩,张克俊*

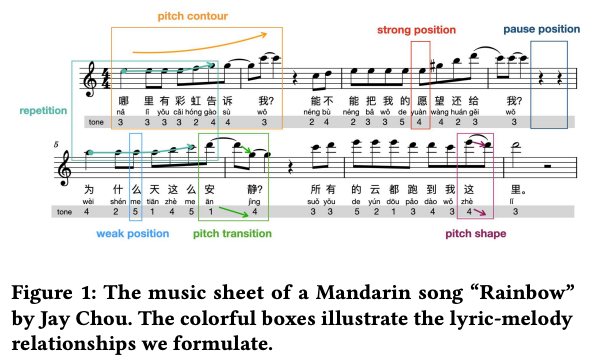

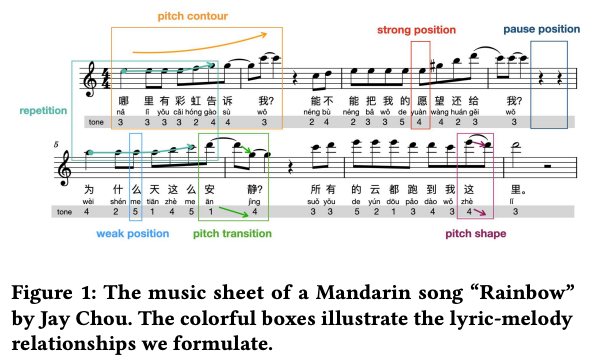

歌词到旋律的生成(Lyric-to-Melody Generation)是AI音乐创作中最重要的任务之一。本文从多角度探索了歌词与旋律的关系,并将歌词与旋律关系融入进AI歌词到旋律生成模型的生成过程中,提升生成旋律的质量以及旋律与歌词之间的和谐度。以往的歌词到旋律生成模型往往采用端到端的神经网络,然而,这些深度学习模型无法很好地捕捉歌词与旋律之间严格但微妙的关系,这损害了歌词与生成的旋律之间的和谐度,影响了整体听感。本文提出了ReLyMe(Relationships between Lyrics and Melodies),从乐理出发,总结出了歌词与旋律在音调、节奏和结构这三方面的关系,并将其整合进歌词到旋律的生成过程中(如图1所示)。

图1 歌曲中的词曲关系

本文对这三个维度的词曲关系分别进行建模,并将其作为约束,整合到神经网络模型的解码过程中,以确保生成的旋律更加贴合词曲关系。我们提出了客观与主观的评价指标,来多维度衡量生成旋律的质量以及其与歌词的和谐程度。更多细节可以参考demo page( https://ai-muzic.github.io/relyme/ )。02 SongDriver: Real-time Music Accompaniment Generation without Logical Latency nor Exposure Bias作者列表:

王子豪、张克俊*、梁启豪、章晨、王雨行、余鹏飞、杨怿恒、王轶楷、刘文博、冯永升、包云泰

.png)

即兴伴奏(实时伴奏)是一项复杂的技能,即使对于人类音乐家而言也具有很高的进入门槛,且在音乐行业中有着非常广泛的应用,例如音乐教育和现场表演等。然而,自动实时伴奏生成方法目前仍然未得到充分研究,需要面临逻辑延迟和曝光偏差之间的权衡。为了音乐专业人士和业余音乐爱好者能够更好地接受和使用即兴伴奏技术,我们团队提出了SongDriver来对自动实时伴奏生成方法展开进一步的研究,其模型架构如下图所示:

.png)

SongDriver有如下特点:

(1)引入乐理信息作为全局信息并指导伴奏生成,并从当代中国流行音乐的吉他谱中构建了原创数据集,为该领域研究提供基准数据库;

(2)采用了双阶段并行机制,编配阶段为输入的旋律编排和弦并缓存到下一阶段,预测阶段根据先前缓存的和弦及旋律为即将到来的时间步生成可播放的多轨伴奏,避免了实时音乐伴奏中的逻辑延迟问题和偏差累积问题,且提升了计算性能;

(3)提出了基于Transformer的实时音乐任务处理模型,在保持CRF极低物理延迟的同时保持较高生成质量

模型架构的组合实验分析、音乐特征的消融实验分析、与现有研究的对比实验结果验证了我们工作的合理性及优越性。未来,我们将继续推进SongDriver的改进与优化研究。

.png)

.png)